반응형

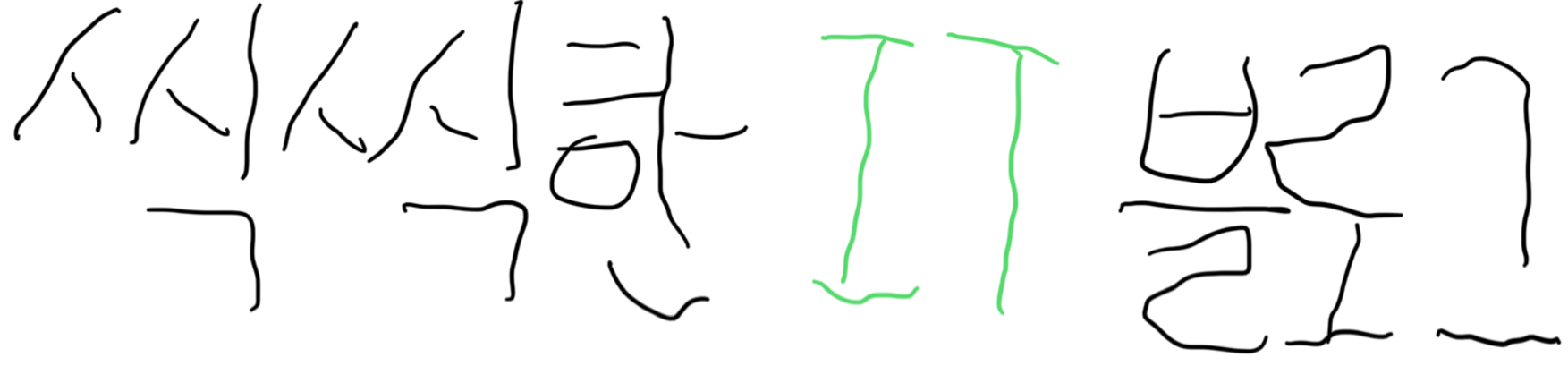

1. softmax

마지막 output layer에는 아무런 활성함수를 넣지 않기 때문에 결과값이 -무한~+무한 을 가질 수 있다.

따라서 이를 logit으로 해석할 수 있고, softmax함수를 이용하여 확률의 형태로 바꿔줄 수 있다.

2. cross entropy

확률형태로 바뀐 결과값 p_ci를 y_i와 비교하여 loss를 측정한다.

이 loss가 바로 cross entropy loss이다. 이를 이용하여 back propagation을 진행하여 파라미터를 개선한다.

* 출처 : 패스트캠퍼스 수학적으로 접근하는 딥러닝 올인원 패키지 Online.

반응형